web

本文最后更新于:2024年2月8日 中午

检索

预训练模型

大规模的数据和模型,学习语料库的知识,将这些知识迁移到某一个具体的任务中,从而获得较好的表现

transforms - 基于位置信息表征,适应较长的文本 -

优势:矩阵乘法为核心,GPU高速运算 -  -

bert:过绕诶家发双向多层,position + Token + segment信息embedding - 预训练

随机mask部分词,然后用上下 - fine-tune: -

选择训练好的最后一层,分类层进行替换,冻结先前的部分, -

利用新的分类层的反相传递优化过层 - 缺点,安全问题,以及 - 优点: -

任务难度大 采用上游预训练,下游微调的范式. -

充分利用了大量的无标签数据,开放世界的知识应用于下游任务,从而大幅度提高了模型效果

- 可以直接使用

-

bert:过绕诶家发双向多层,position + Token + segment信息embedding - 预训练

随机mask部分词,然后用上下 - fine-tune: -

选择训练好的最后一层,分类层进行替换,冻结先前的部分, -

利用新的分类层的反相传递优化过层 - 缺点,安全问题,以及 - 优点: -

任务难度大 采用上游预训练,下游微调的范式. -

充分利用了大量的无标签数据,开放世界的知识应用于下游任务,从而大幅度提高了模型效果

- 可以直接使用

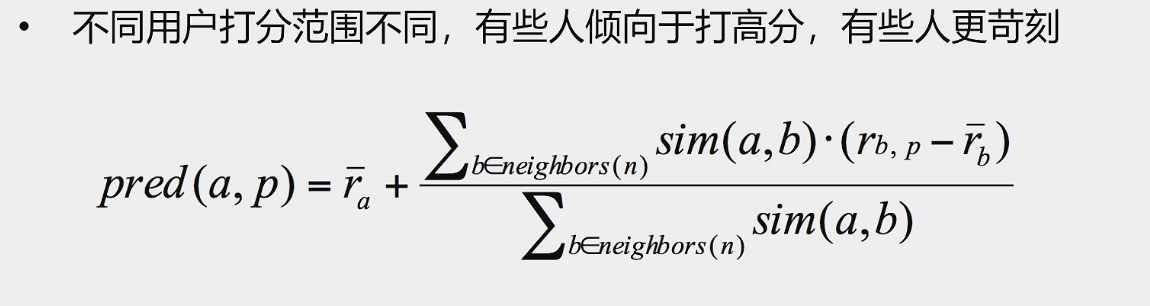

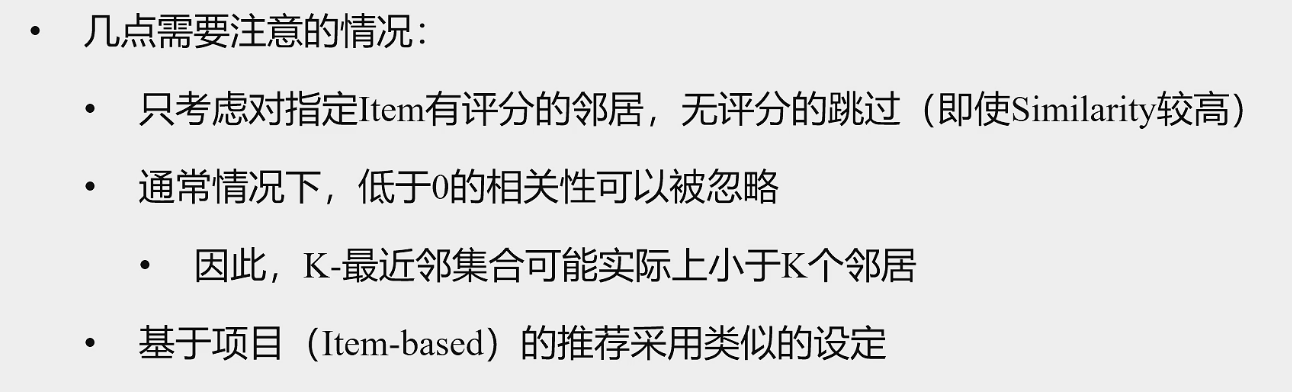

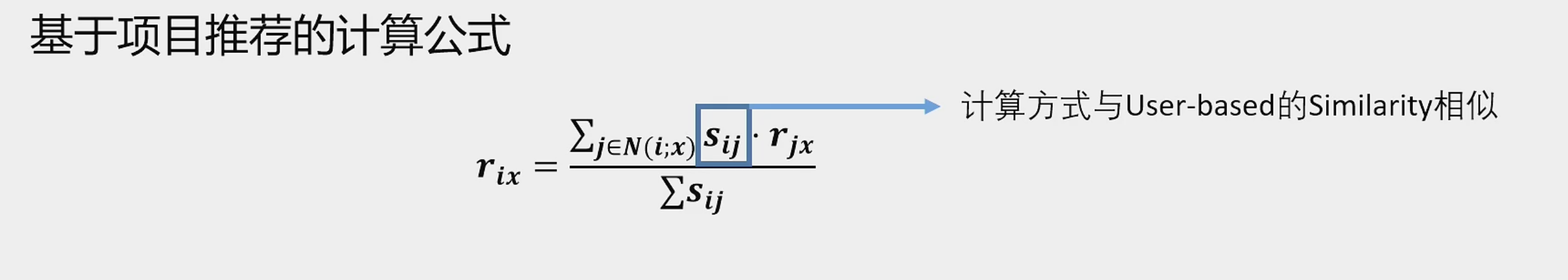

协同过滤

item

web

http://example.com/2023/10/23/web/